Uma nova pesquisa da World Association of News Publishers (WAN-IFRA), realizada em colaboração com a Schickler Consulting, traça um cenário de como as redações estão lidando com Inteligência Artificial (IA) generativa.

O estudo global, feito no final de abril e início de maio, contou com a participação de 101 jornalistas, gerentes editoriais e outros profissionais de notícias sobre o uso de ferramentas de IA generativa em suas redações. Veja abaixo algumas conclusões importantes de suas respostas.

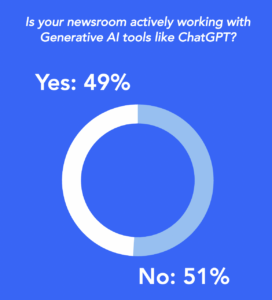

Metade das redações já trabalha com ferramentas GenAI

Dado que a maioria das ferramentas de IA generativa tornou-se disponível para o público apenas alguns meses atrás – no máximo – é bastante notável que quase metade (49%) dos entrevistados disseram que suas redações estão usando ferramentas como ChatGPT. Por outro lado, como a tecnologia ainda está evoluindo rapidamente e de formas possivelmente imprevisíveis, é compreensível que muitas redações se sintam cautelosas a respeito. Esse pode ser o caso dos respondentes cujas empresas ainda não adotaram essas ferramentas.

Dado que a maioria das ferramentas de IA generativa tornou-se disponível para o público apenas alguns meses atrás – no máximo – é bastante notável que quase metade (49%) dos entrevistados disseram que suas redações estão usando ferramentas como ChatGPT. Por outro lado, como a tecnologia ainda está evoluindo rapidamente e de formas possivelmente imprevisíveis, é compreensível que muitas redações se sintam cautelosas a respeito. Esse pode ser o caso dos respondentes cujas empresas ainda não adotaram essas ferramentas.

No geral, a atitude sobre IA generativa no setor é extremamente positiva: 70% dos participantes da pesquisa disseram esperar que as ferramentas de IA generativa sejam úteis para seus jornalistas e redações. Apenas 2% disseram que não veem valor no curto prazo, enquanto outros 10% não têm certeza e 18% acham que a tecnologia precisa de mais desenvolvimento para ser realmente útil.

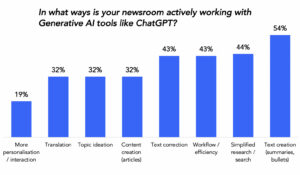

Resumos de conteúdo são o caso de uso mais comum

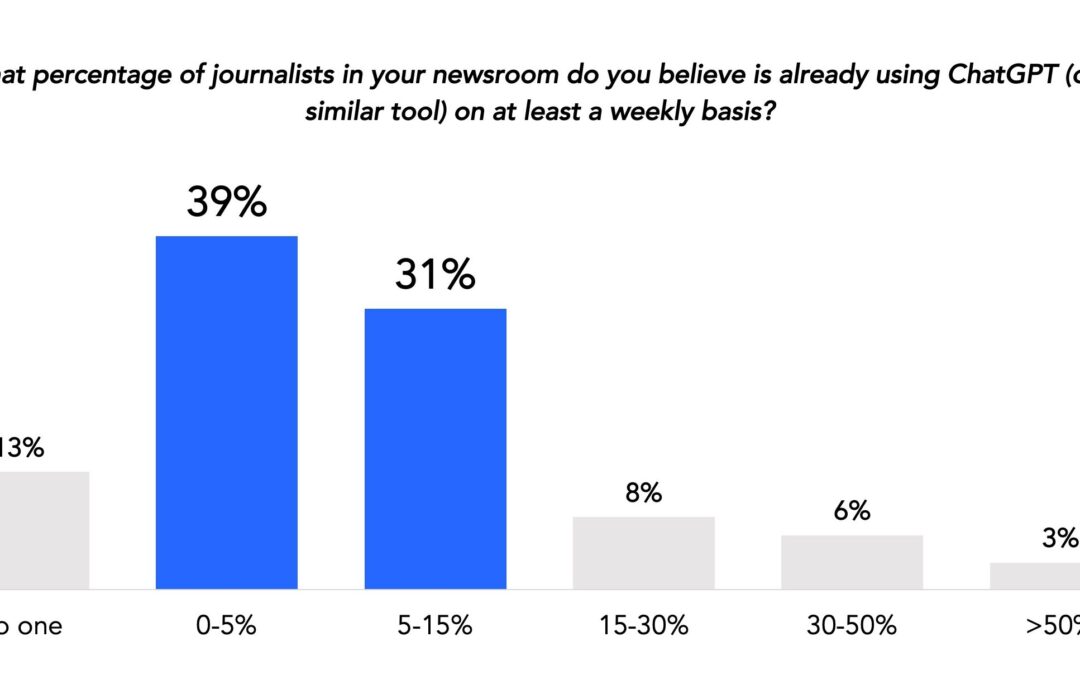

Embora tenha havido algumas reações um pouco alarmistas ao ChatGPT perguntando se a tecnologia poderia acabar substituindo os jornalistas, na verdade o número de redações que usam ferramentas GenAI para a criação de artigos é relativamente baixo. Em vez disso, o principal caso de uso é a capacidade das ferramentas de digerir e condensar informações, por exemplo, para resumos e marcadores, disseram nossos entrevistados. Outras tarefas importantes para as quais os jornalistas estão usando a tecnologia incluem pesquisa/pesquisa simplificada, correção de texto e melhoria dos fluxos de trabalho.

No futuro, é provável que os casos de uso comuns evoluam, à medida que mais e mais redações procuram maneiras de fazer uso mais amplo da tecnologia e integrá-la ainda mais em suas operações. Nossos entrevistados destacaram a personalização, a tradução e um nível mais alto de melhorias no fluxo de trabalho/eficiência como exemplos específicos ou áreas em que esperam que o GenAI seja mais útil no futuro .

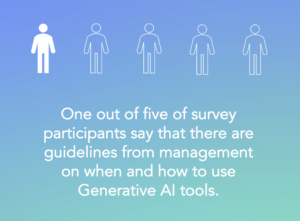

Poucas redações têm diretrizes para o uso do GenAI

Existe uma grande variedade de práticas diferentes quando se trata de como o uso de ferramentas GenAI é controlado nas redações. Por enquanto, a maioria dos editores tem uma abordagem descontraída: quase metade dos participantes da pesquisa (49%) disse que seus jornalistas têm liberdade para usar a tecnologia como bem entenderem. Outros 29 por cento disseram que não estão usando GenAI.

Existe uma grande variedade de práticas diferentes quando se trata de como o uso de ferramentas GenAI é controlado nas redações. Por enquanto, a maioria dos editores tem uma abordagem descontraída: quase metade dos participantes da pesquisa (49%) disse que seus jornalistas têm liberdade para usar a tecnologia como bem entenderem. Outros 29 por cento disseram que não estão usando GenAI.

Apenas um quinto dos entrevistados (20 por cento) disse ter orientações da administração sobre quando e como usar as ferramentas GenAI , enquanto 3 por cento disseram que o uso da tecnologia não é permitido em suas publicações. À medida que as redações lidam com as muitas questões complexas relacionadas ao GenAI, parece seguro supor que mais e mais editores estabelecerão políticas específicas de IA sobre como usar a tecnologia (ou talvez proibir totalmente seu uso).

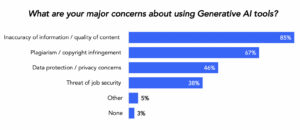

Imprecisões e plágio são as principais preocupações das redações

Dado que vimos alguns casos em que um meio de comunicação publicou conteúdo que foi criado com a ajuda de ferramentas de IA e que mais tarde foi percebido como falso ou impreciso, pode não ser surpreendente que a imprecisão da informação / qualidade do conteúdo seja o número uma preocupação entre os editores quando se trata de conteúdo gerado por IA. 85% dos entrevistados destacaram isso como um problema específico relacionado à GenAI.

Outra preocupação dos editores são as questões relacionadas ao plágio/violação de direitos autorais, seguidas de proteção de dados e questões de privacidade. Parece provável que a falta de diretrizes claras (veja o ponto anterior) apenas amplie essas incertezas e que o desenvolvimento de políticas de IA deve ajudar a aliviá-las, juntamente com treinamento de pessoal e comunicação aberta sobre o uso responsável das ferramentas GenAI.